重大變革正在發生?——我怎麼看這種 AI 末日敘事

周端政|文化系統觀察者・AI 語意工程實踐者・樸活 Puhofield 創辦人

S0|為什麼我要寫這篇

最近在社群上看到一篇被大量轉貼的文章。原文是英文,轉貼者翻成中文,再加上自己的理解。內容大概都在講這兩年大家都感受到的事情——大型語言模型能力跳躍、迭代速度加快、模型越來越聰明。

然後它引用科技圈領袖的發言,把技術進展一層一層堆上去,最後收斂成一句話:

多數白領工作會在五年內被淘汰,你現在必須採取行動。

我看到的第一個感覺,不是震撼,而是警覺。

不是因為技術本身,而是因為敘事方式。

這篇文章的技術描述不全然錯誤,但它把「能力加速」直接外推為「制度崩潰」,這個跳躍,本身值得拆解。

我想做的,不是針對作者或轉貼者,而是針對這種敘事邏輯本身。

接下來,我會一步一步把它拆開來看。

順帶說明,這篇是我口述,由 AI 協助整理。

有些本來更直白、更江湖味的版本,已經被自動降溫與修飾。

看起來比較有禮貌,是因為技術在幫我整理語氣。

S1|為什麼這種文章會讓我過敏

其實每個人在這個世界上,都得有自己狩獵、自己填飽肚子的能力。

所以社群上的公開貼文,我都能理解——

它一定有作者的論點,有作者的想法,也有作者的動機。

這沒有什麼好指責的。

只是,我有一個壞習慣。

看到某些讓我過敏的東西,我還是會忍不住出來講。

尤其是那種——

看起來在分析技術,其實在堆疊焦慮的敘事。

這類文章的結構其實很清楚:

先用疫情當模板——

「一開始大家不信,三週後世界改變。」

再用圈內人身分加權——

「我在裡面,我看到震動。」

接著用模型命名與數據增壓——

版本號、時間翻倍、指數成長。

最後再用職涯威脅收割注意力——

「下一個就是你。」

這整套結構,聽起來是不是很熟?

像不像一個課程銷售漏斗的前半段?

焦慮先建立,產品後進場。

如果站在一個單純賣課的人角度,我完全理解。

大家都要吃飯。

但如果你站在一個有社群影響力的位置,

卻還是用這種結構在製造焦慮,

那你的高度,很容易只剩下流量型賣客。

這才是讓我過敏的地方。

S2|能力不等於制度:為什麼我不同意「一鍵替換」

這類 AI 末日敘事常見的一個推論是:

AI 能做到什麼什麼什麼,

所以人類遲早會被替代。

但如果越過表象去看本質,事情沒有那麼單純。

很多工作並不是幾項技能的集合而已。

它還包含了責任、信任、法規、風險承擔、權限邊界、組織流程,以及最關鍵的——人在現場做判斷、並且承擔後果的能力。

我一直很喜歡用現場例子來說明。

小豪包膜的價值,不在於「他會貼膜」這個技能本身。

而是在現場只要品質出了問題,他可以立刻重新幫客戶重貼一次,確保客戶最後拿到的是達標的結果——有人在現場負責。

這裡面有幾個要素,AI 常被拿來談「能做」,但很少人談「誰扛」:

出問題的時候誰判斷要重做?

誰承擔重做的成本?

誰面對客戶?

誰把品質做到「可以交付」?

這些才是工作真正的制度結構。

再看更高責任密度的現場——例如家醫科的曾醫師。

門診裡的決策不是把報告丟進去、得到答案就結束。曾醫師得在有限時間裡整合病史、症狀、生活情境與風險,把抽象的資訊落回具體的人身上,做出判斷,並為那個判斷負責。

AI 可以協助閱讀文獻、整理資料、提出可能性,甚至寫出極為漂亮的醫療建議文字。

但它不會替曾醫師承擔醫療責任,也不會替醫院承擔法律與風險後果。

所以我常說:能力可以被複製,責任不能外包。

如果有人直接從「AI 能做某件事」外推到「制度將被替換」,那其實是一個邏輯跳躍。這種寫法會讓人產生錯覺,好像世界會像軟體版本更新一樣——一鍵升級,舊版本淘汰。

但我們所處的真實社會不是軟體。

制度不是 App。

它有慣性、有權力結構、有風險管理機制、有法律邊界。技術可以加速能力,但制度是否改變,取決於責任如何被重新分配。這兩件事不能混在一起談。

S3|尼爾森放大定律:AI 是放大器,不是推土機

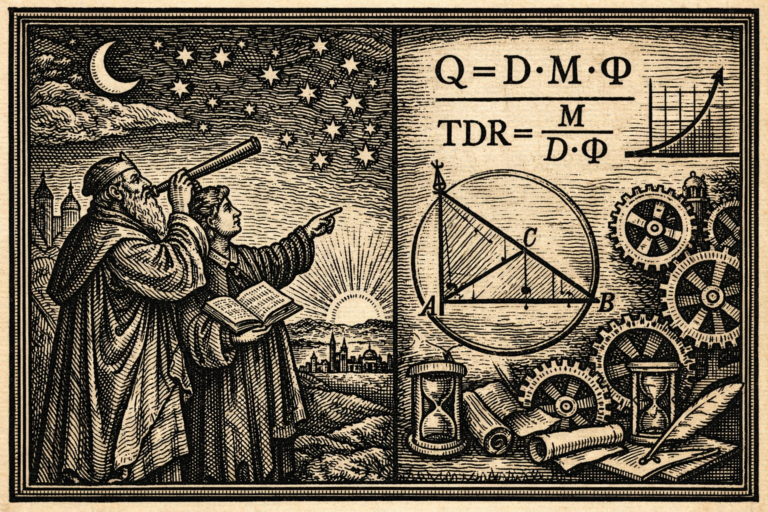

這也是為什麼我提出「尼爾森放大定律」。

這個公式其實很單純,而且完全適用於 AI 的時代。

技術是放大器(M),

放大的是你的本質,

最後決定方向的是你的認知。

AI 本身不是價值。

它是乘數。

你越有料,它越能放大你的有料。

你越有創意,它越能放大你的創意。

你越有判斷力,它越能放大你的判斷力。

但如果你是空洞的,

它也只能放大空洞。

0 乘以無限大,還是等於 0。

所以真正關鍵的,不是 AI 的能力到哪裡。

而是你自己的基底是什麼。

我們人類最寶貴的地方,不是記憶力,不是運算速度。

是判斷力。

是審查能力。

是越過表象,看清本質的能力。

最後決定你怎麼被放大、往哪裡被放大、放大的品質是什麼的——

是你的認知。

是你怎麼判斷。

你怎麼選擇。

你怎麼定位。

你怎麼建立可遷移的能力。

你能不能在不同文化、不同語系、不同領域之間切換?

你能不能把工具放進自己的架構,而不是被工具牽著走?

所以真正的問題從來不是:

「AI 會不會取代你?」

或者

「AI 很快就會取代你?」

真正的問題是:

你會被放大成什麼樣的人?

是效率更高的專業者?

是能夠撇開表象、直指本質的判斷者?

還是只是更焦慮地轉貼焦慮文章的人?

AI 是放大器。

它絕對不是推土機。

它不會一夜之間把制度推平,也不會把世界瞬間改寫。

但它會非常誠實地放大一件事——

一個人到底有沒有料。

到底具不具備真正的人類價值。

還是只是擅長堆疊焦慮。

S4|技術爆發是真的,但決定結果的不是技術

他們常引用一句話:

「1 到 5 年內淘汰 50% 白領。」

我對這句話保持保留態度。

不是否認技術爆發。

技術確實在加速。

現在不是一年一變。

不是一季一變。

甚至不是一個月一變。

幾乎是一週一迭代。

這個我完全承認。

但技術的進步速度,

不等於制度的吸收速度。

制度要處理的是什麼?

-

誰負責

-

誰背書

-

誰賠償

-

誰合規

-

出事誰扛

制度不是軟體版本更新。

它不能一鍵升級。

教育制度會時間錯位。

醫療制度會時間錯位。

法規永遠滯後於技術。

這是歷史規律。

從農業到工業,

從蒸氣機到自動化,

每一次技術革命改變的,

都不是「人類瞬間消失」。

改變的是工作的重心。

從勞力密集,

到效率密集,

再到判斷密集。

而這正好回到我提出的模型。

Nelson Amplification Law

NAL-2026-02-09-v1.0

Q = D × M × Φ

-

Q:輸出品質

-

D:判斷密度

-

M:機器放大倍率

-

Φ:是否審查(是否有審核機制)

如果 D 趨近於 0,

就算 M 趨近於無限大,

結果還是 0。

零乘以無限大,還是零。

AI 不會讓人變笨。

它只會把你原本的結構放大。

有料的人,被放大。

沒料的人,被放大。

不審查的人,也會被放大。

差距不是被消除。

是被擴大。

所以真正的問題不是:

AI 會不會在五年內淘汰 50% 白領。

真正的問題是:

當 M 急速上升時,

你的 D 是多少?

你的 Φ 存不存在?

如果你沒有判斷密度,

沒有審查能力,

那你會更快產出焦慮、

更快產出錯誤、

更快產出低品質內容。

這才是最真實的結構。

S5|真正的分水嶺:不是技術爆發,是認知差距

真正的問題從來不是「AI 會不會淘汰你」。

真正的問題是——

認知差距正在被放大。

焦慮型敘事之所以有市場,是因為它迎合低判斷密度的恐慌反應。

大量轉貼、情緒渲染、末日式語言,

本質上都是一種 低 D、低 Φ 的輸出。

判斷密度低,

審查能力低,

於是只能依靠外部權威、數字、預測來堆疊壓迫感。

但如果你把視角往下壓一層,就會發現——

真正有價值的從來不是預測。

而是它暴露了什麼。

一、能力邊界的移動,暴露的是誰在跟進

有些人已經在用最強模型做實務。

他們知道能力邊界正在移動。

他們知道什麼能做,什麼不能做。

他們知道哪裡需要人類負責。

但還有大量的人,

停留在兩年前的免費版體驗。

兩年前連算術都會出錯。

現在卻能通過專業資格考。

於是有人震驚。

有人恐慌。

有人說末日到了。

老實說,我有時候不知道該笑還是該哭。

因為那不是末日。

那只是——

你對能力邊界的認知落差。

二、認知落差的解法不是恐慌

認知差距不會因為焦慮而消失。

如果你用情緒來填補落差,

你只會變成情緒型轉貼者。

焦慮會被放大。

恐慌會被放大。

空洞也會被放大。

然後你會把人類最寶貴的東西交出去:

判斷力。

而這正好回到我的模型。

Q = D × M × Φ

如果你不提升 D(判斷密度),

不建立 Φ(審查能力),

那 M 再強,只會放大混亂。

三、真正的分水嶺是「可遷移能力」

未來的分水嶺不是:

-

你會不會用 AI

-

你有沒有焦慮

-

你有沒有跟風

而是:

-

你的能力能不能遷移

-

你的判斷能不能跨場景

-

你能不能跨文化、跨語系、跨制度切換

-

你能不能在不同平台維持結構一致性

真正有價值的人,是:

-

能越過表象看本質

-

能辨識哪些被工具放大

-

能清楚界定責任與背書邊界

-

能在制度之內操作,而不是幻想制度會消失

AI 不會決定你是誰。

它只會把你放大成你本來的樣子。

有料的人,被放大。

空洞的人,被放大。

焦慮的人,也被放大。

差距不是被消除。

是被加速拉開。

S6|大局觀:不要被末日標題收割你的注意力

如果你問我:

那我到底應該怎麼看待這一切?

我會把問題收斂成一句話:

不要把你的注意力,交給末日式標題。

那些標題——

-

AI 太強了

-

人類要被取代

-

五年內淘汰一半白領

-

看完你會驚呆

這種語氣,本質上跟低品質農場文沒有差別。

它不是在提升你的判斷。

它是在勞動你的情緒。

用焦慮換注意力。

一、注意力,是這個時代最稀缺的資產

真正的問題不是 AI。

真正的問題是——

你把注意力放在哪裡。

如果你把注意力放在末日敘述,

你會得到焦慮。

如果你把注意力放在權威預測,

你會得到不確定。

但如果你把注意力放在:

-

越過表象

-

穿越制度

-

看見責任與權限的邊界

-

理解技術與制度的吸收落差

那你會得到結構。

二、真正能穩住的,不是技能

在變化很快的時代,一切都很難預測。

模型會變。

平台會變。

產業會變。

甚至國家與制度都會調整。

但你可以決定的是什麼?

不是哪一項技能。

不是你現在在哪個位置。

而是——

你能不能穩住自己。

真正能被保留的,是:

-

判斷力

-

審查能力

-

跨制度理解能力

-

跨文化切換能力

-

可遷移的認知結構

單一技能會過時。

單一平台會消失。

單一市場會收縮。

但結構型能力,可以轉移。

三、真正被放大的,是認知品質

如果你把這一切拉高來看,就會發現:

被放大的,不是世界末日。

被放大的,是認知品質的差距。

品質越高的人,被放大的是什麼?

-

更清晰的判斷

-

更穩定的輸出

-

更高密度的思考

-

更強的遷移能力

品質越低的人,被放大的又是什麼?

-

焦慮

-

情緒

-

轉貼

-

放大恐慌

這才是真正的分水嶺。

四、重新配置自己,而不是恐慌

所以如果你問我:

現在最有價值的是什麼?

不是去看某個大頭說什麼。

不是去轉貼某篇末日文章。

不是去預測五年後誰會消失。

最有價值的是:

提升你的判斷密度。

提升你的審查能力。

建立可遷移的結構能力。

然後重新配置自己。

跨文化。

跨制度。

跨平台。

跨產業語言。

AI 只是放大器。

它不會決定你是誰。

但它會加速拉開——

誰有料,誰沒料。

差距不會消失。

只會變得更清楚。

FAQ|AI 焦慮敘事 × Nelson Amplification Law

1️⃣ Nelson Amplification Law(尼爾森放大定律)是什麼?

Nelson Amplification Law 指出:

Q = D × M × Φ

Q 為輸出品質。

D 為判斷密度(Decision Density)。

M 為機器放大倍率(Machine Multiplier)。

Φ 為審查係數(Review Filter)。

此模型強調:AI 並非主體,而是放大器。

真正決定結果品質的,是人類的判斷與審查能力。

2️⃣ 為什麼說 AI 不會直接取代人類?

因為「能力執行」與「制度責任」是兩件事。

AI 可以產生合約文本。

但法律責任不會自動轉移。

AI 可以給出診斷建議。

但醫療背書與風險承擔仍屬於人類制度。

技術能力 ≠ 制度替換。

3️⃣ 為什麼焦慮型文章容易流傳?

焦慮型敘事具備三種結構:

-

使用權威加權

-

使用數據倍增曲線

-

使用末日式時間壓迫

這種結構能快速收割注意力。

但不等於提升判斷品質。

4️⃣ 技術進步很快,制度會跟不上嗎?

技術迭代速度以週為單位。

制度吸收速度以年為單位。

制度必須處理:

-

責任歸屬

-

合規框架

-

風險承擔

-

賠償機制

-

權限邊界

因此社會不會「一鍵升級」。

5️⃣ 判斷密度(D)是什麼?

判斷密度指:

在單位時間內,你能夠做出高品質結構判斷的能力。

包含:

-

跨文化理解

-

跨制度切換

-

責任界線辨識

-

本質問題抽象化能力

判斷密度越高,AI 放大的品質越高。

6️⃣ 審查係數(Φ)為什麼重要?

Φ 代表你是否對 AI 輸出進行審查。

若 Φ = 0,

即便 D 很高、M 很強,

最終仍可能產生錯誤放大。

審查能力,是防止技術錯誤外溢的關鍵。

7️⃣ 為什麼「0 × ∞ 仍然等於 0」?

若判斷密度 D 趨近於 0,

即便機器倍率 M 趨近無限大,

結果仍為 0。

這代表:

AI 不會讓人變聰明。

它只會放大既有結構。

8️⃣ 真正被放大的到底是什麼?

不是末日。

不是白領淘汰比例。

真正被放大的,是:

-

認知品質差距

-

審查能力差距

-

結構思考能力差距

差距不是被消除。

而是被加速拉開。

9️⃣ 面對 AI 時代,最值得培養的是什麼能力?

不是單一技能。

而是可遷移能力:

-

跨制度思考

-

跨文化判斷

-

跨平台輸出結構

-

跨語系理解

這些能力能在技術更替中持續有效。

🔟 如何避免被焦慮敘事收割?

判斷一篇文章時,可檢視:

-

它是否提供結構?

-

是否說明責任邊界?

-

是否提出方法論?

-

還是僅使用時間壓力製造恐慌?

若僅強調「即將淘汰你」,

卻無結構建議,

那只是情緒型內容。

1️⃣1️⃣ AI 是否會改變世界?

會。

但世界不等於軟體版本。

社會結構包含:

-

法律

-

信任

-

組織責任

-

風險分配

-

文化慣性

這些不會同步於模型更新速度。

1️⃣2️⃣ 最終核心問題是什麼?

不是 AI 能不能取代你。

而是:

你會被放大成什麼樣的人?

效率更高的專業者?

還是焦慮放大的轉貼者?

這取決於你的 D 與 Φ。